La détection scientifique de la fraude : quelles évolutions ?

Le risque de fraude est très important dans certains secteurs d’activité. La lutte contre ce fléau passe par une complémentarité d’approches entre une méthode classique et des solutions plus évoluées faisant appel à l’intelligence artificielle. État de l’art des méthodes récemment mises en œuvre pour tenter de mieux détecter ce risque.

Un risque de fréquence

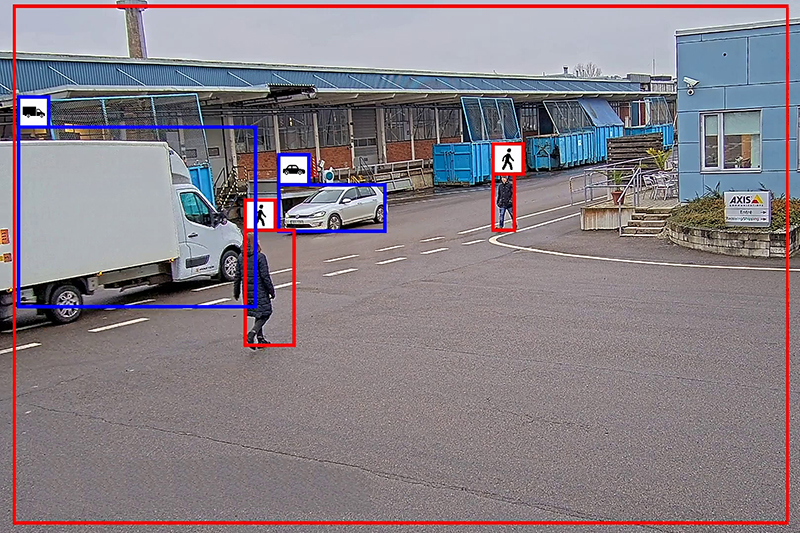

Le risque de fraude, notamment la fraude externe, est entré dans les priorités des risk managers. Dans certains secteurs (banque, assurance, e-commerce, téléphonie), il est devenu un risque de fréquence, c’est-à-dire un risque à forte probabilité de survenance, et dont les impacts financiers cumulés deviennent conséquents.

« La fraude est devenue un fléau. Ce n’est même plus un risque puisqu’on sait que dans certaines régions, il est une certitude, évoque un risk manager du secteur de la téléphonie. La seule question qu’on se pose encore est comment sécuriser nos nouvelles offres face à la fraude qui surviendra puisque les fraudeurs sont en veille et attendent la sortie de nos offres pour lancer des schémas d’escroquerie. »

« Dans certains secteurs le risque de fraude est devenu un risque de fréquence, c’est-à-dire un risque à forte probabilité de survenance. »

La méthode des scénarios

Continuez votre lecture… Abonnez-vous !

Si vous êtes déjà abonné, connectez-vous.

En ce moment

Ce numéro 613 de Face au Risque consacre un dossier spécial à la sûreté des musées à travers :…

Le vendredi 7 mai 2021, la compagnie Colonial Pipeline annonce être victime d’une cyberattaque. Tandis qu’une rançon est réclamée…

À l’occasion de la Journée mondiale du mot de passe, il est nécessaire d’alerter sur la vulnérabilité croissante des mots…

La hauteur du lieu ne va pas définir stricto sensu si l’espace en cause est un espace confiné ou…

Le modèle traditionnel d'organisation de l'évacuation, reposant sur des guides et des serre-files désignés et connus de tous, a fait…

En cette journée mondiale du 28 avril dédiée à la sécurité et à la santé au travail, l'Agence européenne…