L’usage de l’IA dans un cadre professionnel comporte des risques pour les entreprises

Alors que de nombreuses entreprises voient en l’intelligence artificielle (IA) une opportunité, son déploiement massif dans un cadre professionnel comporte également des risques.

L’intégration de l’intelligence artificielle dans les processus de travail est souvent présentée comme un moyen de gagner en efficacité et en productivité. Pour autant, l’usage de l’IA dans un cadre professionnel n’est pas sans risques.

Selon un sondage réalisé par l’institut OpinionWay auprès de dirigeants et de cadres d’entreprises, pour le compte de l’assureur QBE, 19% des entreprises interrogées ont déjà intégré l’IA dans leurs processus de travail, et 19% prévoient de le faire. D’après le même sondage, 37% des représentants d’entreprises interrogés considèrent que l’IA pourrait avoir un impact positif sur la productivité de leur société. 8% estiment que cet impact pourrait être négatif, et 55% qu’il n’y aura pas d’impact notable.

Compromission des données, biais discriminatoires… Les risques liés à l’IA sont nombreux

Pour autant, l’IA comporte de réels risques. En fournissant à des services d’IA des informations, comme des données clients ou des données financières par exemple, les entreprises peuvent prendre le risque de se faire dérober ces informations par des pirates informatiques. Dans un article dédié au sujet publié sur son site internet, l’assureur Generali considère par exemple que “l’IA générative risque de compromettre la sécurité des données, mais également les diffuser involontairement”. Le média spécialisé Daf Mag, qui s’adresse à des décideurs administratifs et financiers, note que “les données transmises à l’outil [d’IA] peuvent être réutilisées et ne sont pas couvertes par le secret”.

Un second risque identifié est celui de biais dans les décisions prises par les outils d’IA. Certaines entreprises se tournent désormais vers l’IA pour prendre des décisions, notamment en termes de recrutement. Dans un rapport publié en novembre 2024, l’équivalent britannique de la CNIL mettait en garde sur les risques associés à ces pratiques de recrutement. Les outils d’IA ont, dans certains cas, collecté plus d’informations que nécessaire. Les algorithmes ont par exemple pu déduire le genre ou l’ethnicité des candidats sur la simple base de leur CV.

De manière générale, plusieurs études ont démontré que les biais humains se retrouvent largement dans les comportements des IA, ce qui peut avoir des conséquences discriminantes en termes de recrutement.

Informations imprécises ou erronées

Un autre risque posé par l’intelligence artificielle est celui de prises de décision basées sur des informations erronées. En effet, les IA génératives, comme ChatGPT par exemple, fournissent parfois des informations imprécises, voire carrément fausses. Sans vérifications humaines, ces informations peuvent alimenter des prises de décision.

Par exemple, lorsque, pour tester la fiabilité de ChatGPT, nous lui avons demandé le taux de détenus présentant un trouble dépressif dans les prisons françaises en 2011, le chatbot a répondu 23%, en nous renvoyant vers un lien d’une étude de la DREES portant sur un tout autre sujet, et ne mentionnant en aucun cas ce chiffre de 23%. En refaisant le même test plusieurs semaines plus tard, ChatGPT donne cette fois un taux de 40%, mais se révèle incapable de fournir une source précise de cette information. Les données fournies par l’intelligence artificielle doivent donc toujours être prises avec du recul, et faire l’objet d’une rigoureuse vérification humaine.

Enfin, l’IA présente également le risque d’une perte de sens au travail. Une étude du Conseil économique, social et environnemental, publiée en janvier 2025, indique ainsi que “le management algorithmique, déployé notamment dans les entreprises dites de plateformes, peut conduire à une déshumanisation de la gestion des ressources humaines, ainsi qu’à une perte d’autonomie pour les salariés. Il peut en outre occasionner un risque de perte de compétences et de déresponsabilisation des managers”.

Camille Hostin – Journaliste

Les plus lus…

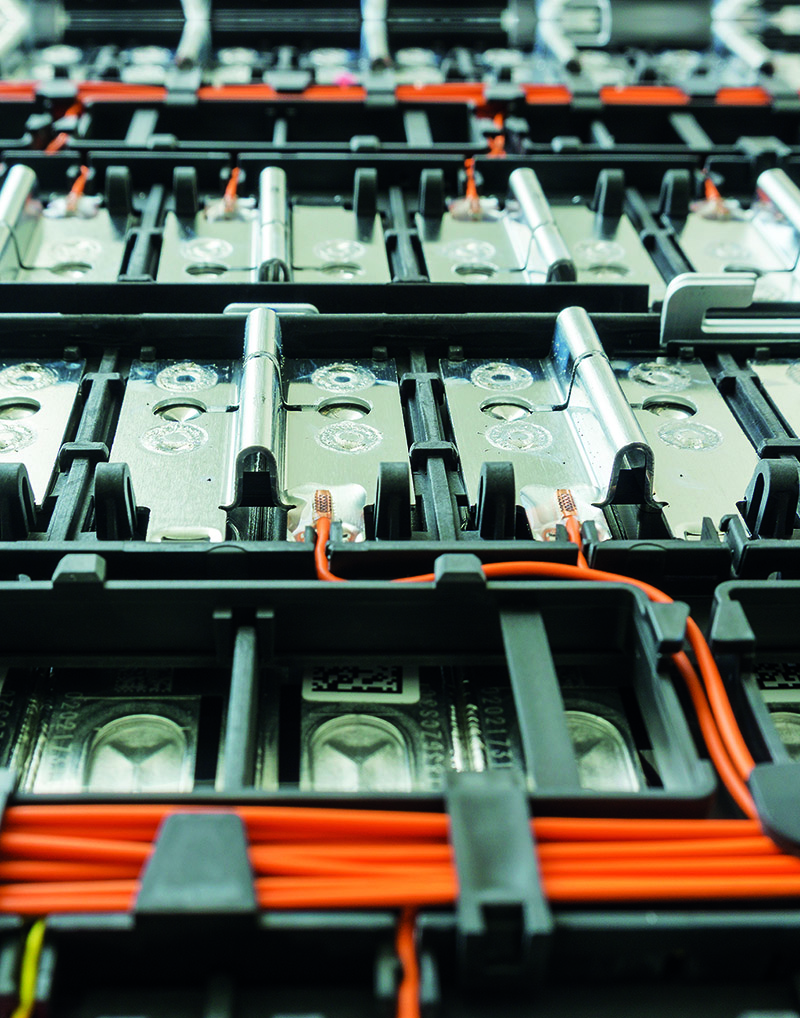

L'entreprise Blue Solutions, filiale du groupe Bolloré, a répondu aux accusations de l'entreprise Highway France Logistics 8, propriétaire de…

Deux décrets ainsi qu’un arrêté, tous trois en date du 11 juin 2025, portent sur les règles de sécurité incendie…

Ce numéro 608 du magazine Face au Risque (juillet - août 2025) consacre un dossier spécial à la vidéosurveillance…

Un décret publié au Journal officiel le 27 juin 2025 et entré en vigueur le 1er juillet élargit les zones…

L’AFCDP (Association française des correspondants à la protection des données) annonce la publication du livrable du groupe de travail…

Les ambitions du monde de la sûreté finiront-elles par faire bouger les lignes du cadre législatif dans les cinq…